勤業眾信的研究顯示,僅有 23% 的組織認為已為管理 AI 相關風險做好充分準備,因此在監督與安全性方面存在重大缺口。

什麼是 AI 治理?

AI 治理是指政策、框架和監督系統,用以指導人工智慧的開發、使用和監管方式。它可確保人工智慧在組織、產業和政府間以透明、咎責和安全的方式運作。

保護人工智慧系統,使其能夠安全、合乎道德且符合法規地運作,已成為當務之急。如果沒有適當的治理,人工智慧系統可能會帶來偏見、違反法規要求或成為安全風險。

舉例來說,以過往僱用資料為基礎訓練的 AI 招募工具,可能會在不經意之間將某些個人特徵置於其他個人特徵之上,強化歧視。在醫療照護或金融等領域,若不遵守地區資料保護法而部署人工智慧,可能會導致違法行為和巨額罰款。

此外,整合至面向公眾服務的 AI 模型若沒有足夠的威脅預防控制,可能會被惡意利用嘗試攻擊,使組織暴露於網路攻擊和作業中斷。

AI 治理的主要原則

明確的 AI 治理策略包含基本原則,可協助組織維持對 AI 驅動決策的控制。根據Ponemon Institute 的調查,54% 的受訪者已採用 AI,而 47% 的安全團隊表示擔心 AI 產生的程式碼會造成漏洞。

以下基本原則是有效 AI 治理的核心,有助於降低作業與安全風險:

安全通訊協定可保護人工智慧模型免受敵對攻擊、未經授權的修改,以及新興的網路威脅。

咎責性可確保人工智慧系統有指定的監督,防止不受管制的決策,並加強人類的控制力

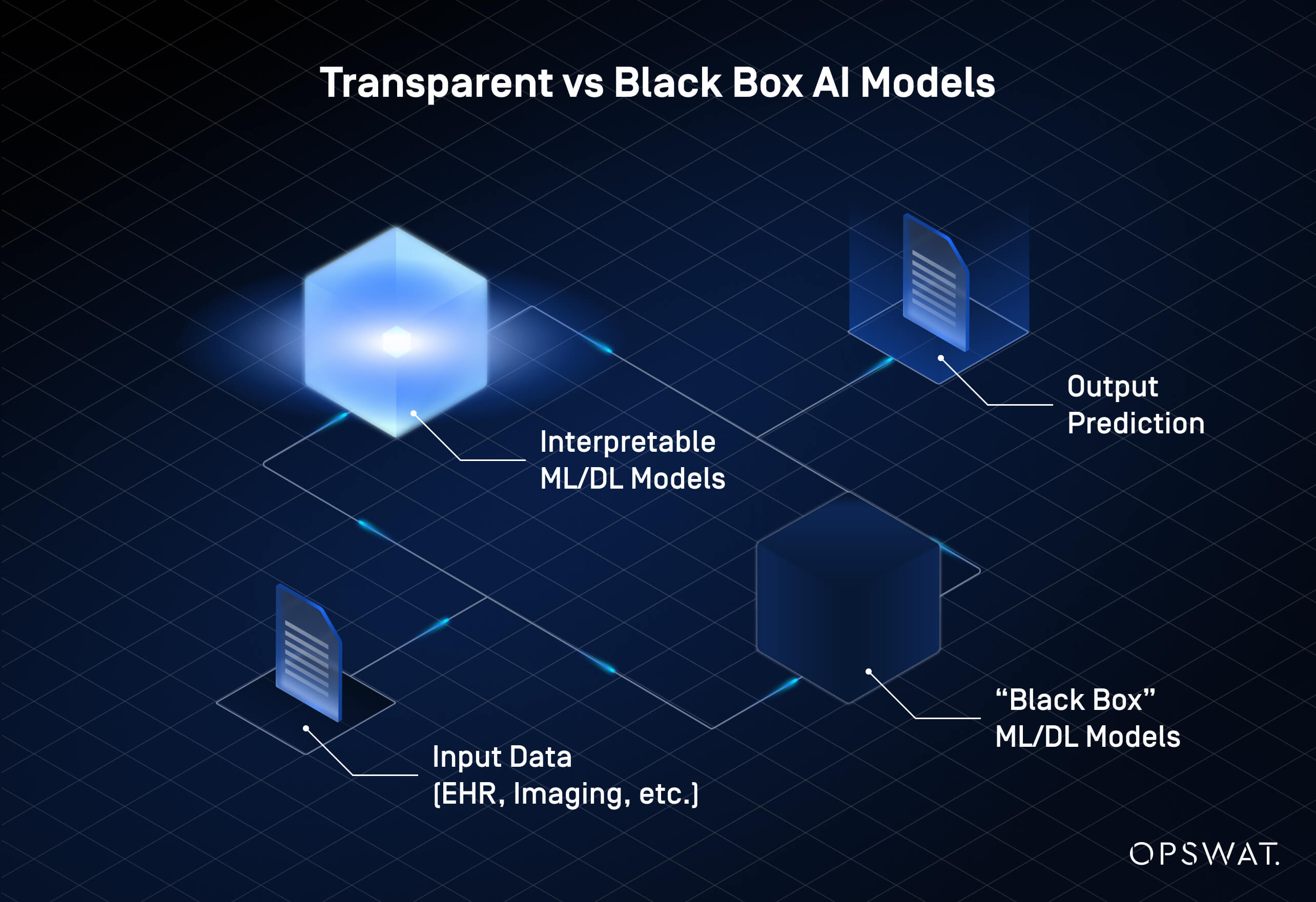

透明度要求人工智慧模型提供清晰的決策過程洞察,降低缺乏可解釋性的「黑箱」模型的風險

透過將這些原則嵌入治理架構,組織可以降低風險,同時維持 AI 技術的效率與可擴充性。

人工智慧風險管理的需求與日俱增

AI 的快速應用為風險管理與合規性帶來了新的挑戰。 如果沒有適應性策略,組織就有可能在應對新興威脅和法規壓力方面落後於人。

AI 風險管理著重於

- 根據不斷演進的法規和特定行業的 AI 監督任務調整治理策略,確保組織符合法律要求

- 持續的偏見偵測與公平性稽核對於防止 AI 決策中的歧視模式是必要的

- 人工智慧增強的網路釣魚攻擊、深度偽造詐欺和模型操縱日益令人擔憂,需要採取主動的安全措施

為了知名這些風險,組織必須將 AI 治理納入更廣泛的風險管理架構中,以確保合規、安全性與道德考量仍是 AI 開發與部署不可或缺的一環。

AI 治理框架

結構化的 AI 治理架構可協助組織掌握合規要求、管理風險,並將安全措施整合至 AI 系統。將明確的安全治理模式納入 AI 風險管理架構,可減少 AI 計畫的分散性,並加強法規遵循的涵蓋範圍。

架構發展

開發 AI 治理架構需要符合組織政策與法規標準的策略方法。以下要素代表了有效框架開發流程的核心組成部分:

風險評估

找出 AI 模型中的弱點,包括偏見、隱私問題和安全威脅。

法規整合

確保 AI 治理符合特定產業的要求和全球標準。

跨功能合作

建立一個能同時解決道德問題和營運需求的管理架構。

與現有組織政策整合

AI 治理不應獨立運作,而應與更廣泛的企業網路安全、道德與風險管理政策相結合。將 AI 政策納入企業風險管理,可確保 AI 模型符合安全規範與道德準則。

AI 稽核機制可協助及早偵測治理失敗,而合規性追蹤則可讓企業在不斷演進的法規面前保持知名。與 AI 廠商和安全供應商建立外部合作關係,也能強化治理策略,降低與第三方 AI 解決方案相關的風險。

實施策略

成功的 AI 治理需要結構化的實施方法,同時利用技術和政策驅動策略。許多組織正在轉向使用 AI 驅動的法規遵循工具,以自動化治理流程並即時偵測違反法規的情況。主要的實施措施包括

- 技術驅動的法規遵循解決方案使用 AI 來追蹤政策遵循情況、監控風險因素,以及自動化稽核程序

- 變更管理策略可確保 AI 治理政策在整個組織中獲得採納

- 事件回應規劃可處理特定於 AI 的安全風險,確保組織具備主動措施,以管理治理失敗、網路攻擊和違反道德的行為

透過將治理架構嵌入現有政策,並採用結構化的實施策略,組織可以確保人工智慧系統保持安全、道德與合規。

道德準則與責任

由於人工智慧系統影響重大決策,組織必須建立道德準則與責任結構,以確保負責任的使用。如果沒有治理保障措施,人工智慧可能會帶來偏見、危及安全性或在法規界限之外運作。

建立道德準則

合乎道德的 AI 治理著重於公平性、透明度與安全性。以下做法對於建立 AI 開發與部署的道德基礎至關重要:

- 道德人工智慧的原則與標準有助於確保人工智慧在可接受的範圍內運作,避免意想不到的後果

- 制定道德規範,將負責任的人工智慧使用正式化,並就透明度、資料隱私和責任感設定明確的指導方針

建立咎責架構

為了確保 AI 治理的可執行性,組織需要能追蹤合規性並實施矯正行動的機制。常見的咎責措施包括:

- AI 稽核可評估模型效能、合規性和安全漏洞

- 事件回應規劃可讓組織做好準備,以應對與 AI 相關的故障、安全漏洞和治理失誤

透過將倫理準則和責任措施嵌入治理架構,組織可以管理 AI 風險,同時維持信任與合規性。

法規架構

遵守法規架構至關重要,然而許多組織卻很難跟上政策演進的步伐。根據 Deloitte 的報告,法規的不確定性是採用 AI 的最大障礙,許多企業實施治理架構以因應法規遵循的風險。

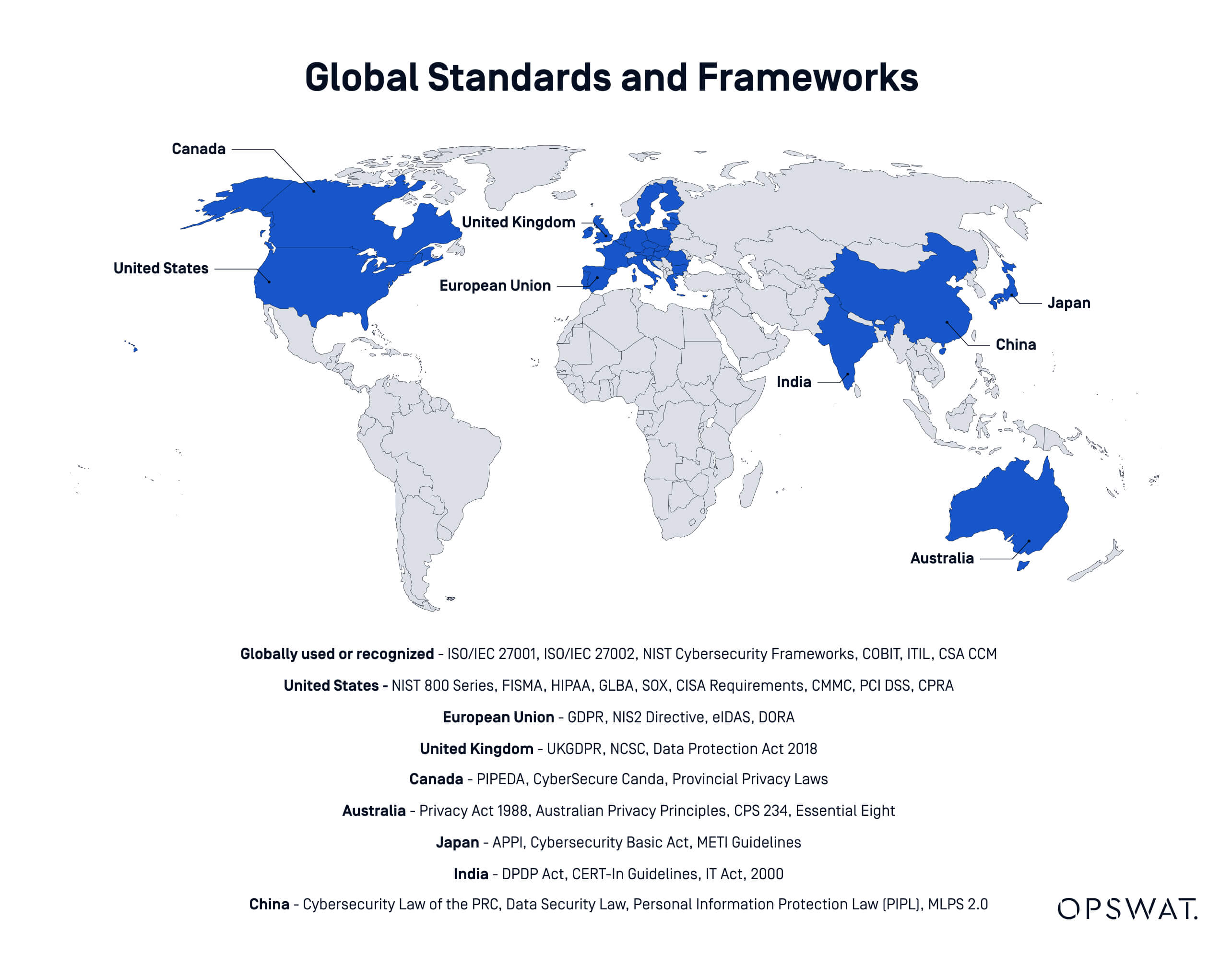

全球法規概述

AI 治理受特定區域法律的影響,每個區域都有不同的合規要求。以下範例說明各主要司法管轄區的法規有何差異:

- 歐盟 AI 法案建立了嚴格的監督,要求高風險 AI 應用的透明度、風險評估和人工監督。根據第 6 條,人工智慧系統若在關鍵基礎建設部門運作,即視為高風險。在歐盟營運的組織必須使其 AI 政策符合這些準則。

- 美國 SR-11-7為金融機構的 AI 設定了風險管理預期,著重於模型驗證、治理和安全控制。各行各業也出現了類似的特定行業指導方針。

- 其他國際政策,包括加拿大、新加坡和中國的法規,強調人工智慧的道德使用、消費者保護和企業責任。企業必須追蹤其部署 AI 的地區的法規發展。

透過將倫理準則和責任措施嵌入治理架構,組織可以管理 AI 風險,同時維持信任與合規性。

合規策略

確保符合 AI 法規需要採取主動積極的方法。以下策略可協助組織調整治理架構,使其符合不斷演進的法律要求,尤其是在使用高風險的 AI 系統時:

- 建立法規遵循團隊可讓組織管理法規風險、監督 AI 稽核,以及執行所需的治理措施

- 面對法規挑戰,需要持續監控政策變更,同時在法規經常重疊的複雜環境中調整治理結構。

- 法規稽核與報告可協助組織展現合規性,並透過主動監控預防法律風險

透過將合規策略嵌入 AI 治理架構,組織可以降低法規風險,同時確保 AI 維持道德與安全。

透明度和可解釋性

組織面臨著越來越大的壓力,必須讓 AI 驅動的決策可以解釋,尤其是在金融、醫療保健和網路安全等高風險應用領域。儘管如此,許多 AI 模型仍然很複雜,限制了它們運作的能見度。

設計透明的 AI 系統

AI 透明化涉及讓利害關係人、監管者和最終使用者都能理解決策流程。以下方法可支援人工智慧的可解釋性並有助於降低與所謂黑箱人工智慧模型相關的風險,因為這些模型的內部運作並不容易理解:

- 有效的溝通策略可協助組織將 AI 決策轉化為清晰、可詮釋的產出。提供檔案、模型摘要和影響評估可以提高透明度。

- 透明化工具與技術可深入瞭解 AI 模型如何處理資料並產生結果,從而確保可解釋的 AI。AI 審計工具、可解釋性架構和可解釋的 AI (XAI) 技術有助於減輕對黑箱決策的疑慮。

透過優先考量透明度,組織可以改善法規一致性、降低偏見相關風險,並建立對 AI 應用程式的信任。

監控與持續改善

AI 治理是一個持續的過程,需要持續監控、風險評估和完善,以確保安全性和合規性。隨著 AI 驅動的系統處理越來越多的敏感資料,組織必須建立安全的工作流程,以防止未經授權的存取和違反法規。

管理式檔案傳輸解決方案在人工智慧政策執行、維持可稽核性及降低人工智慧驅動的資料交換中的法規遵循風險方面扮演關鍵角色。

績效指標與回饋迴圈

追蹤 AI 系統效能對於確保可靠度、安全性與合規性至關重要。以下實作有助於強健的監控與適應性治理:

- Secure 工作流程可防止未經授權的存取,並確保人工智慧驅動的資料交換遵循嚴格的安全政策。OPSWAT MetaDefender Managed File Transfer MFT)™ 解決方案能協助企業實施加密措施、存取控制及自動化合規監控,從而降低資料外洩風險。

- 自適應的治理機制可讓 AI 模型根據持續回饋完善決策,同時維持嚴格的安全性與合規措施。AI 驅動的安全解決方案,例如Managed File Transfer 平台,可協助即時對敏感資料進行分類,確保遵守不斷演進的法規要求。

建立持續改善的風險框架

AI 驅動的工作流程必須持續評估漏洞,尤其是網路威脅不斷演進時。根據世界經濟論壇(World Economic Forum)的資料顯示,72% 的受訪組織表示過去一年網路風險增加,主因是網路釣魚、社交工程、身分盜竊和網路詐騙增加。以下策略可支援長期的復原能力:

- 由人工智慧驅動的安全防護機制,透過整合先進威脅偵測、資料外洩防護及合規管控,全面保障人工智慧資料交換安全。Managed File Transfer MFT)™解決方案,確保企業能安全傳輸人工智慧敏感資料,同時避免增加法規合規風險。

- 自動化的法規遵循執行可將預先定義的安全政策套用至所有 AI 相關的檔案傳輸,進而簡化法規遵循的程序。透過利用 AI 驅動的治理解決方案,組織可以降低資料外洩的風險,同時維持營運效率。

透過將安全資料工作流程嵌入人工智慧治理策略,組織能強化安全性、維持合規性,並確保人工智慧驅動決策的完整性。諸MetaDefender Managed File Transfer MFT)等解決方案,可提供必要防護措施以支援安全且合規的人工智慧運作。

MetaDefender Managed File Transfer MFT) – 人工智慧安全與合規解決方案

MetaDefender Managed File Transfer MFT) 在人工智慧安全治理中扮演關鍵角色,其提供:

- 政策強制的檔案傳輸,可自動套用安全控制,例如存取限制、加密要求和合規驗證

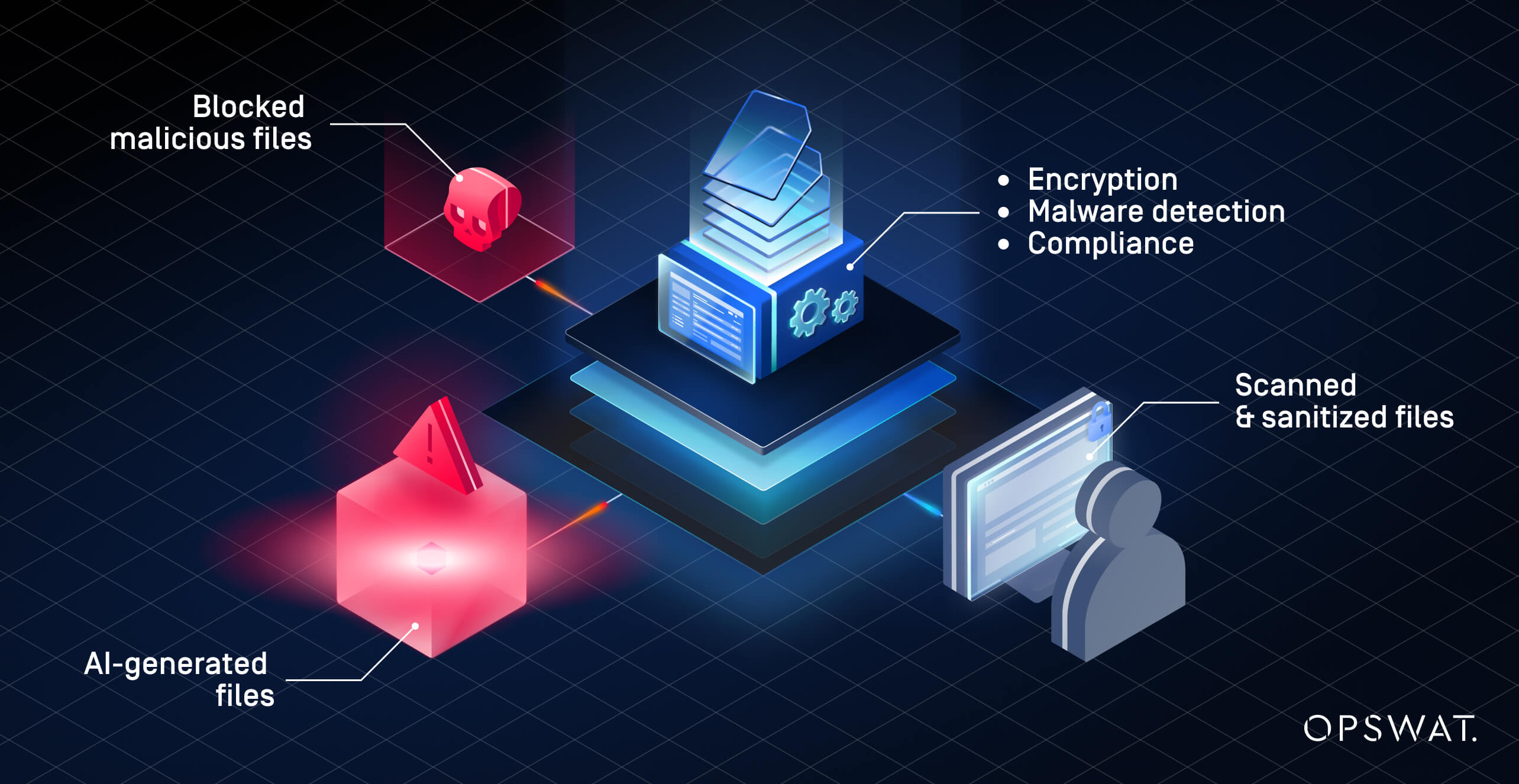

- 透過分層偵測,識別並阻斷惡意軟體、贖金軟體、內嵌指令碼及其他人工智慧產生的攻擊中常用的檔案型威脅,提供進階的威脅預防功能

- 透過整合稽核記錄、角色式存取控制和可自訂的政策強制執行,以符合法規為導向的安全措施,支援包括 GDPR、PCI DSS 和 NIS2 在內的法規要求

- 安全、受管理的資料工作流程,可確保 AI 驅動的檔案傳輸經過加密 (AES-256、TLS 1.3)、完整性驗證,並在整個交換過程中防止篡改或注入惡意有效載荷。

- 透過整合Multiscanning 啟發式及機器學習引擎、Deep CDR™ 技術及人工智慧驅動的沙箱技術 MetaDefender Managed File Transfer MFT) 解決方案能保護人工智慧生成的資料免受不斷演變的網路威脅侵害,同時確保符合人工智慧治理規範。

保護人工智慧驅動的資料工作流程

AI 模型依賴於經常在多個系統之間移動的大量資料,因此安全的資料傳輸至關重要。如果沒有適當的控制,AI 產生和 AI 處理的資料很容易受到篡改、未授權存取或違法行為的侵害。

MetaDefender Managed File Transfer MFT) 透過以下方式確保人工智慧驅動的資料工作流程持續受到保護:

- 使用 AES-256 和 TLS 1.3 進行端對端加密,確保資料在傳輸途中和靜止時的安全

- 透過 Active Directory 整合、SSO (單一登入) 和 MFA (多因素驗證) 進行嚴格的驗證和存取控制,防止未經授權的資料交換

- 透過校驗和驗證進行資料完整性驗證,確保人工智慧產生的檔案在傳輸過程中不被篡改

透過執行這些安全措施,組織可以安全地將 AI 驅動的流程整合至現有的基礎架構,而不會讓敏感資料暴露於風險中。

AI 驅動的威脅預防

人工智慧生成的內容帶來了新的安全挑戰,包括敵對性人工智慧攻擊、嵌入式惡意軟體及基於檔案的漏洞利用。Managed File Transfer MFT)透過多重防護層強化安全機制,在人工智慧驅動的網路攻擊觸及關鍵系統前予以攔截。

這些功能使MetaDefender Managed File Transfer MFT)成為全面的安全解決方案,專為依賴人工智慧驅動的資料交換、同時需要防止惡意軟體入侵及合規違規的組織而設計。

合規驅動的 AI 治理

人工智慧生成的數據須接受嚴格監管,要求組織實施安全政策以確保符合不斷演進的法律框架。Managed File Transfer MFT)透過在每次檔案傳輸中整合主動式合規控制機制,協助企業滿足這些要求:

- Proactive DLP™可掃描人工智慧產生的檔案中的敏感內容,防止未經授權的資料外洩,並確保符合 GDPR、PCI DSS 和 NIS2 等法規。

- 全面的稽核記錄與法規遵循報告可提供 AI 相關檔案傳輸的可見性,讓組織追蹤存取、修改與政策執行情況

- RBAC (以角色為基礎的存取控制)強制執行細緻的權限,確保只有授權使用者才能依照管理政策存取或傳輸 AI 相關檔案

憑藉這些治理能力Managed File Transfer MFT)不僅能保障人工智慧資料安全,更能協助組織符合監管要求,從而降低與人工智慧驅動流程相關的法律與營運風險。

透過MetaDefender Managed File Transfer MFT) 強化人工智慧安全防護

由人工智慧驅動的數據工作流程需要強大的安全與合規控制措施。Managed File Transfer MFT)為人工智慧驅動環境提供進階威脅防護、法規遵循及安全數據交換解決方案。深入了解OPSWAT業界領先的託管檔案傳輸解決方案MFT 如何MFT 您的AI治理策略。